A nova agenda da IA em saúde passa pela saúde mental

Durante muito tempo, falar de inteligência artificial em saúde significava discutir eficiência, automação de processos e redução de custos. Esse ciclo começa a se encerrar. A IA deixou de ser um tema periférico de inovação para se tornar uma prioridade estratégica, com impactos diretos sobre decisões humanas, cuidado e responsabilidade institucional.OpenAI anunciou o ChatGPT Health: […]

Durante muito tempo, falar de inteligência artificial em saúde significava discutir eficiência, automação de processos e redução de custos. Esse ciclo começa a se encerrar. A IA deixou de ser um tema periférico de inovação para se tornar uma prioridade estratégica, com impactos diretos sobre decisões humanas, cuidado e responsabilidade institucional.

OpenAI anunciou o ChatGPT Health: A nova agenda da IA em saúde passa pela saúde mental

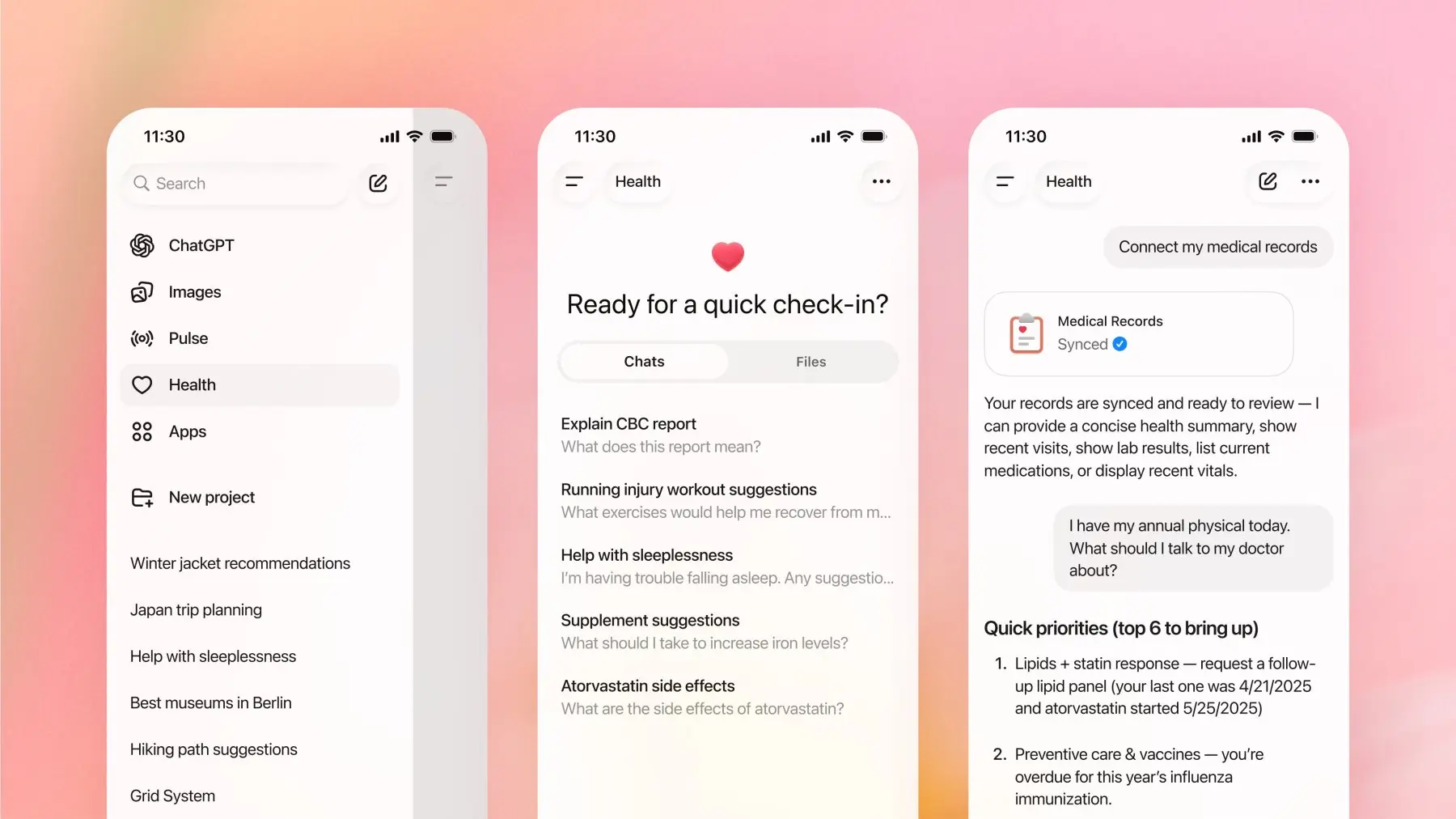

A OpenAI anunciou o ChatGPT Health, uma iniciativa voltada a organizar e interpretar dados de saúde de forma integrada, conectando informações clínicas, registros de bem-estar e histórico do usuário. Não é um ruído, é sinal. Cada vez mais, os sistemas de IA passam a ocupar um espaço contínuo na relação das pessoas com sua própria saúde.

Esse avanço recoloca uma questão central que muitas organizações ainda tratam de forma secundária: o lugar da saúde mental na transformação digital da saúde.

IA, cuidado e experiência real de uso

Na prática, ferramentas baseadas em linguagem não são vividas como softwares neutros. Elas conversam, validam emoções, organizam pensamentos e ajudam pessoas a tomar decisões. Em muitos casos, funcionam como primeiro recurso diante do sofrimento psíquico, especialmente fora do horário comercial, em contextos de solidão ou sobrecarga.

A experiência real de uso não segue o marketing nem os rótulos técnicos. Mesmo quando descritas como ferramentas de suporte ou bem-estar, essas tecnologias passam a mediar processos subjetivos profundos. É nesse ponto que surgem riscos pouco visíveis, como dependência, substituição informal do cuidado, decisões mal orientadas, falhas de escalonamento e ausência de responsabilização clara.

O debate internacional já mudou de patamar

Análises internacionais indicam que a adoção de IA em saúde deixou de ser experimental. O foco global já não está em discutir se a IA será utilizada, mas como esse uso será governado, especialmente em áreas sensíveis como a saúde mental.

Uma análise recente da revista TIME discute os dilemas relacionados à privacidade, confiança e responsabilidade quando ferramentas de IA passam a lidar com dados de saúde e decisões pessoais. O debate central não é tecnológico, mas institucional.

Saúde mental como dimensão de governança

Quando a IA entra na saúde, entram também risco, ética e responsabilidade. A saúde mental faz parte dessa equação e não pode ser tratada como um efeito colateral da tecnologia. Ignorar essa dimensão não elimina riscos. Apenas desloca seus impactos para zonas menos visíveis, onde as consequências costumam aparecer de forma tardia, fragmentada e difícil de reparar.

Para organizações, isso exige revisar modelos de governança, critérios de risco e responsabilidades internas, além de integrar tecnologia, saúde, jurídico, ESG e liderança. Isso não significa conter a inovação, mas reconhecer que tecnologias que interagem com sofrimento humano demandam estruturas claras de cuidado, monitoramento e accountability.

Uma pergunta necessária

A discussão sobre IA e saúde mental já acontece no presente, na forma como pessoas usam essas ferramentas e na ausência ou presença de sistemas preparados para responder por seus efeitos.

A pergunta que permanece é: quem está olhando para isso de forma estruturada dentro das organizações?

Fonte: https://time.com/7344997/chatgpt-health-medical-records-privacy-open-ai