Ética, IA e Psicologia: Como garantir confiança, segurança e equidade no uso de tecnologias digitais na saúde mental

O uso ético da IA na Psicologia é essencial para proteger dados, reduzir vieses e fortalecer o cuidado em saúde mental. A Bee Touch, com a AVAX, integra tecnologia e ética, seguindo diretrizes da APA para apoiar profissionais de forma segura e responsável.

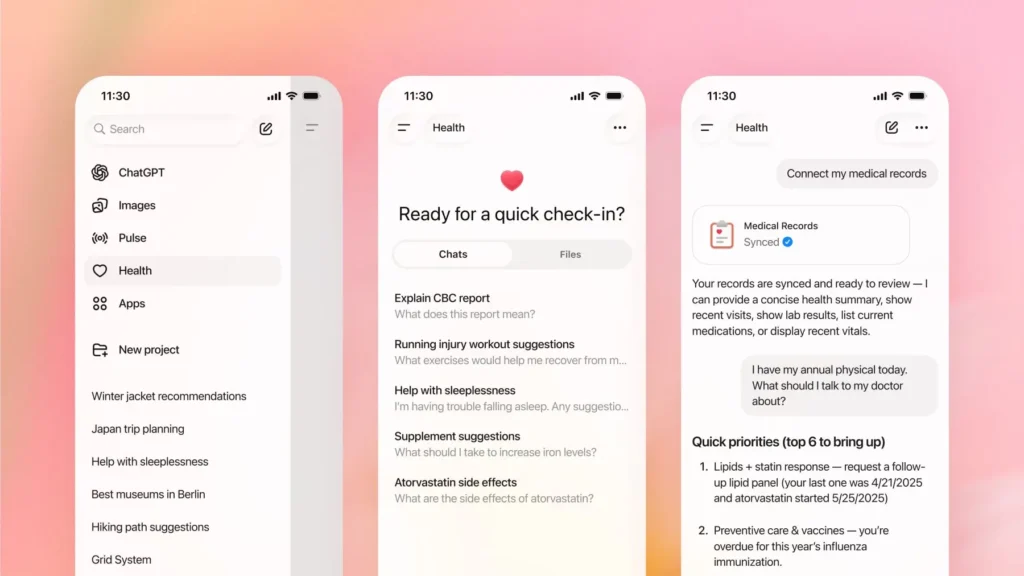

O uso de inteligência artificial (IA) na Psicologia está deixando de ser uma tendência para se consolidar como parte das práticas clínicas e organizacionais. Soluções digitais como a AVAX vêm transformando a forma como avaliamos riscos psicossociais, antecipamos vulnerabilidades e estruturamos planos de cuidado baseados em dados. No entanto, esse avanço técnico exige mais do que inovação: requer compromisso ético.

A American Psychological Association (APA) publicou recentemente o documento Ethical Guidance for AI in the Professional Practice of Health Service Psychology, que orienta o uso responsável da IA na atuação profissional. A seguir, destacamos os seis pilares principais da diretriz, conectando-os com os fundamentos que sustentam o trabalho da Bee Touch no campo da saúde mental digital.

Transparência e consentimento informado

O uso de IA deve ser comunicado de forma clara, acessível e adequada ao contexto cultural de quem recebe o serviço. Psicólogos têm a obrigação ética de informar o propósito, os limites e os riscos envolvidos, garantindo que o consentimento seja verdadeiramente consciente.

Na Bee Touch, todos os processos da AVAX incluem termos explícitos de consentimento digital. O participante é informado sobre como os dados serão utilizados, quem poderá acessá-los e quais funcionalidades envolvem inteligência artificial. Essa transparência fortalece a confiança e protege o vínculo entre profissionais, instituições e trabalhadores.

Mitigação de viés e promoção da equidade

Sistemas de IA precisam ser continuamente avaliados para evitar a reprodução de injustiças históricas e vieses algorítmicos. Ferramentas que ignoram contextos sociais, gênero, raça ou ocupação podem aprofundar desigualdades.

A AVAX foi concebida com base em estudos psicométricos robustos, testada em diferentes setores e ajustada para refletir a diversidade da força de trabalho brasileira. O objetivo não é só mensurar, mas garantir que a análise respeite a pluralidade de realidades e minimize o risco de distorções interpretativas.

Privacidade e segurança de dados

A coleta e o processamento de dados sensíveis em saúde mental envolvem riscos que não podem ser subestimados. Psicólogos têm a responsabilidade de adotar ferramentas compatíveis com legislações como a LGPD, garantindo confidencialidade e segurança.

Na Bee Touch, investimos em proteção de dados desde a concepção da plataforma. A arquitetura da AVAX segue boas práticas de cibersegurança e nenhum dado é compartilhado com terceiros sem autorização expressa. Sigilo, rastreabilidade e governança de dados são princípios operacionais, não apenas jurídicos.

Precisão e riscos de desinformação

A validação científica de ferramentas baseadas em IA é obrigatória. Psicólogos devem avaliar criticamente as tecnologias que utilizam, e interromper seu uso sempre que houver dúvidas quanto à acurácia ou à coerência dos resultados.

A AVAX não substitui o julgamento clínico ou estratégico, ela oferece subsídios. Relatórios e dashboards são interpretados por equipes capacitadas, e nossos algoritmos passam por revisões periódicas. O compromisso com a integridade é permanente.

Supervisão humana e julgamento profissional

Inteligência artificial não é autonomia profissional delegada. Psicólogos continuam sendo responsáveis pelas decisões clínicas ou institucionais e não devem terceirizar esse julgamento a sistemas automatizados.

A AVAX foi desenhada para potencializar a análise humana, não para substituí-la. A tecnologia aponta padrões, tendências e sinais de alerta. Mas, a decisão sobre o que fazer com essas informações é sempre do profissional, da liderança ou do comitê responsável.

Responsabilidade ética e legal

O cenário jurídico sobre IA em saúde mental ainda está em construção. Psicólogos devem se antecipar a riscos legais, compreendendo os limites éticos da tecnologia e garantindo formação adequada para quem a utiliza.

Por isso, a Bee Touch oferece suporte técnico e científico às empresas usuárias da AVAX. Nossos treinamentos abordam tanto o uso operacional, quanto os aspectos éticos e jurídicos da gestão de riscos psicossocial baseada em dados.

Ética como bússola na inovação em saúde mental

Na Bee Touch, acreditamos que tecnologia sem ética é atalho para a desconfiança. Confiança não se impõe, se cultiva. Ao seguir as diretrizes da APA e incorporar princípios éticos desde o início do processo, ampliamos não apenas a eficácia, mas a legitimidade da intervenção em saúde mental.

A inteligência artificial pode acelerar diagnósticos, sinalizar padrões e ampliar o acesso a estratégias de prevenção. Contudo, é a ética que orienta o rumo. Ela define os limites do uso, sustenta a qualidade do cuidado e protege o que não pode ser automatizado: o vínculo humano.

Referência:

American Psychological Association. (2024). Ethical Guidance for AI in the Professional Practice of Health Service Psychology. APA Services.

Disponível em: https://www.apa.org/topics/artificial-intelligence-machine-learning/ethical-guidance-ai-professional-practice

-

Tags:

- #IA

- #Psicologia